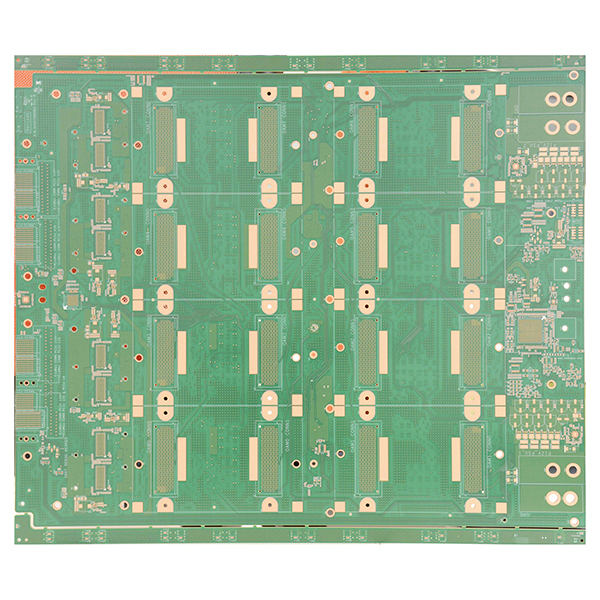

ai universal baskort UBB tillverkning för sammankoppling av acceleratorer

I AI-servrar fungerar UBB-moderkortet inte bara som bärare för GPU-plattformen och möjliggör effektiv dataöverföring och utbyte, utan blir också, med sin höga prestanda, höga stabilitet och skalbarhet, kärnstödet för AI-datainfrastruktur.

Beskrivning

Definition av AI UBB-kort

AI UBB, Universal Base Board, är ett avancerat bakplan eller moderkort som är utformat för att tillhandahålla ström, signaler, hantering och höghastighetsanslutningskanaler för AI-acceleratorkort som OAM-moduler, GPU:er och FPGA:er. Det fungerar vanligtvis som den centrala sammankopplingsplattformen i AI-servrar eller AI-acceleratorchassi, såsom NVIDIA HGX, Baidu Kunlun och Alibaba Hanguang, vilket gör det till en viktig hårdvarufundament för moderna AI-datacenter.

Huvudfunktioner för AI UBB Board

- Möjliggör höghastighetskoppling mellan flera AI-acceleratorkort och värdprocessorn, samt mellan acceleratorkort, med stöd för protokoll som PCIe, NVLink och CXL.

- Ger enhetlig strömfördelning, kylningsgränssnitt, distribution av hanteringssignaler och funktioner för hälsoövervakning.

- Stödjer olika typer av AI-acceleratormoduler, vilket ger hög kompatibilitet och flexibel skalbarhet.

- Säkerställer datavägar med hög bandbredd och låg latens för effektivt datautbyte och överföring.

Huvudfunktioner i AI UBB PCB-tillverkning

- Ultrahögt lagerantal (≥20 lager), stor storlek (i allmänhet över 400 × 500 mm) och kartongtjocklek ≥3 mm.

- Använder avancerade material med extremt låg förlust för att uppfylla kraven på högfrekvent signalöverföring.

- Använder avancerade processer som bakborrning, hartsfyllda vior och POFV, med minsta borrhål på 0,2 mm och bildförhållande ≥15.

- Hög spårdensitet ned till 0,09/0,09 mm, med en viss precision för impedansreglering som når ±8%.

- Stöder högeffektsleverans och moduler som kan bytas ut direkt, med starka kylnings- och strömhanteringsfunktioner.

- Mycket anpassad design med enastående tillförlitlighet och stabilitet, lämplig för storskalig AI-klusterdistribution.

Huvudsakliga tillämpningar av AI UBB-kortet

- OAM, Open Accelerator Module, arkitektur för AI-servrar, fungerar som brygga mellan OAM-moduler och moderkort/CPU.

- Core backplane för AI-serverplattformar som NVIDIA HGX, som tillhandahåller sammankoppling för flera GPU:er/AI-acceleratorkort.

- Högpresterande AI-servrar med vätske- eller luftkylning, vilket möjliggör modulär expansion och hantering av AI-kluster med hög densitet och hög datorkraft.

- Används i superdatorcentra, datacenter och storskaliga molnplattformar för AI för avancerade AI-applikationer.

Skillnader från traditionella bakplan

- UBB-korten är särskilt utformade för ekosystemet för AI-acceleratorer, med stöd för högre bandbredd (t.ex. PCIe Gen4/Gen5, NVLink, CXL) och högre effektkrav.

- Större fokus på flexibel expansion och mångsidig kompatibilitet mellan AI-moduler, vilket möjliggör snabb utveckling av AI-teknik och hårdvara.

- Ger högre signalintegritet och systemtillförlitlighet, vilket gör den till en oumbärlig komponent för storskaliga AI-beräkningsplattformar.

English

English  Français

Français  Tiếng Việt

Tiếng Việt  Italiano

Italiano  Nederlands

Nederlands  Türkçe

Türkçe  Svenska

Svenska  Polski

Polski  Română

Română  Latviešu

Latviešu  한국어

한국어  Русский

Русский  Español

Español  Deutsch

Deutsch  Українська

Українська  Português

Português  العربية

العربية  Indonesian

Indonesian  Čeština

Čeština  Suomi

Suomi  Eesti

Eesti  Български

Български  Dansk

Dansk  Lietuvių

Lietuvių  Bokmål

Bokmål  Slovenčina

Slovenčina  Slovenščina

Slovenščina  Ελληνικά

Ελληνικά  Magyar

Magyar  עברית

עברית